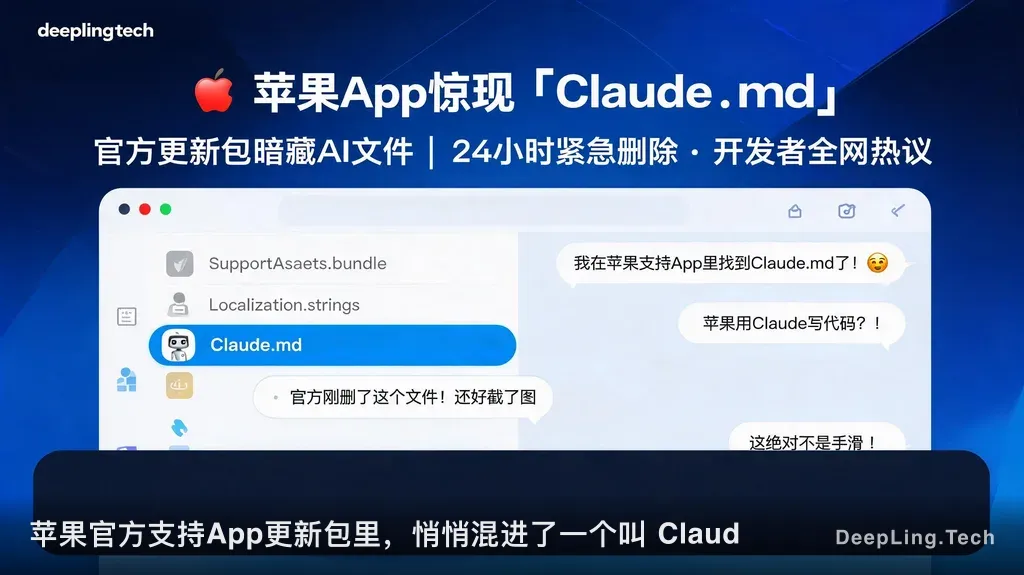

苹果APP里塞了个神秘文件,全网都在问:你们用Claude写代码了?

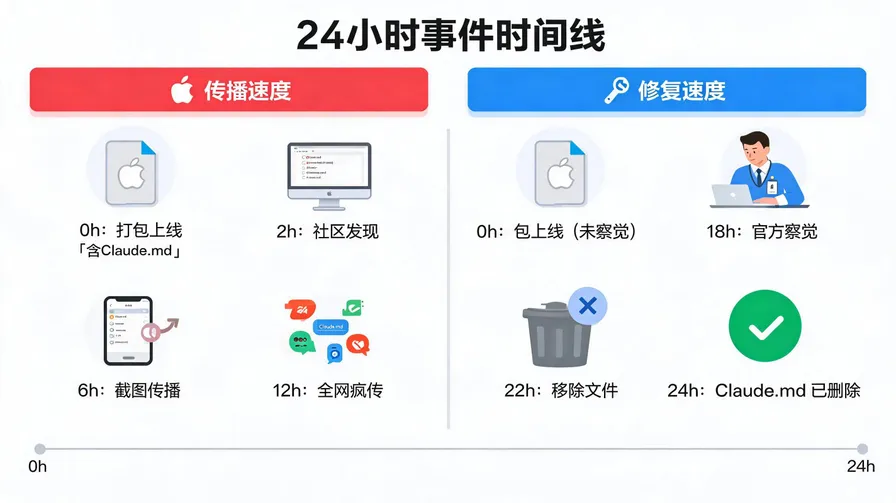

苹果官方支持App更新包里,悄悄混进了一个叫 `Claude.md` 的文件。24小时内被删了,但截图已经在开发者社区传疯了。

苹果官方支持App更新包里,悄悄混进了一个叫 Claude.md 的文件。24小时内被删了,但截图已经在开发者社区传疯了。

这事看起来像是"手滑"——但稍微深想一层,你就知道问题没这么简单。苹果有全球最严苛的代码审核流程,一个配置文件能被漏进去,唯一的解释是:它根本就没被当成问题。

当AI生成的内容越来越多地进入软件供应链,谁来替这些代码兜底?

[MEME: 先别急]

它不是手滑,是系统盲区

先说清楚事件本身。

根据科技媒体报道,苹果在近期一次应用更新中,意外打包了一个 Claude.md 文件。这个文件通常长这样:开发者用来给Claude设定项目背景、代码规范、任务模板的配置文件——简单说,就是告诉AI"这个项目怎么写"的指令集。

苹果发现后大约24小时内删除了文件。

技术社区的反应很有意思:有人说这是苹果"偷偷用Claude"实锤,有人说这只是开发者测试疏忽,有人开始研究配置文件内容想挖点内部信息。苹果至今没有官方回应。

Vibe Coding:懒人编程的日常

要理解这件事为什么值得聊,得先知道什么叫"Vibe Coding"。

这是最近开发者社区流行的一个词,指的是开发者把大部分编码工作丢给AI,自己只负责"说清楚要什么"和"最后验收一下"。你给AI一个方向感,一个"氛围",它生成代码,你测试,反馈,继续调,直到跑通。

听起来很美对吧?省脑子,省时间,省力气。

Claude.md 这类配置文件,就是这个模式的核心工具——你把项目背景、技术栈、代码规范写进去,AI就能"理解"你要什么,生成更贴合项目的代码。

问题来了:当配置文件越来越多,当AI产出越来越多进入最终产品,谁在审查这些AI写的东西?

一个配置文件,撕开了一道口子

答案可能是这样的:苹果的审核流程根本没把AI生成的内容当"需要审查的代码"——它可能出现在某个开发者的本地环境里,被复制、引用、迭代,然后顺理成章地进了打包流程,没人在意它的来源。

这不是苹果一家的问题。

传统软件供应链的逻辑是"信任链":代码有人写、有人审、有人发布,每个环节都有人负责。但当AI大量参与代码生成,这套逻辑正在失效。代码的"出生证明"变得模糊。审查者不知道自己审的是什么。依赖项的范围从开源库扩展到了模型训练数据、AI服务商的能力。

苹果这次泄露的配置文件,就是这条隐式依赖链的一次意外显形。

核心问题:谁来审查AI的产出?

这不是在质疑苹果"有没有用Claude"——这个问题不重要,也难以证实。

真正值得整个行业面对的问题是:AI生成的代码,正在进入生产环境,但对应的质量保障机制,几乎是空白。

现状是什么样的?AI模型基于统计模式匹配生成代码,它能"看起来对",但不保证"真的对"。安全漏洞、逻辑错误、兼容性问题,可能都藏在看起来正常的代码里。

传统的代码审查假设审查者能理解代码逻辑,但面对AI产出,追问本身可能没有意义——因为AI的"决策"是隐式的。

同时,Vibe Coding的核心心态是"让AI干活",开发者对AI输出的信任度天然偏高。在这种心理下,配置文件被当作正常代码打包,是大概率事件,不是小概率失误。

一个建议:把AI产出放进审查清单

苹果这次没出什么大事。文件删了,没有用户数据泄露,企业声誉受损有限。

但它留下的作业值得整个行业认真对待。最直接的一条:把AI生成的内容纳入正式审查流程。不是因为AI写的就一定有问题,而是因为目前没有机制能保证它没问题。

具体来说:涉及安全、隐私、合规的模块,不允许跳过人工审核;配置文件类内容的打包,需要额外确认来源;AI辅助开发的内部规范,需要明确哪些环节可以用、哪些环节必须人审。

苹果的这次"乌龙",是一个信号。它不是说某家公司做错了什么,而是说整个行业还没准备好——当AI越来越多地参与代码生产,相应的治理框架必须跟上。

这不是苹果的问题,是整个行业的问题。

[MEME: 绷住]